Eu havia colocado aqui no começo do ano este POST que media a eficiência dos programas de anti vírus de acordo com os testes de Janeiro da av-comparatives.org.

Agora em Outubro, eles lançam os mesmos testes para sabermos como continua a qualidade destes programas.

E existem muitas empresas que fabricam produtos de antivírus para o seu PC que procuram fazer um produto que realmente nos proteja de tantos ataques. E sabemos que as opções de produtos gratuitos muitas vezes não trazem a mesma proteção que as soluções pagas.

Dentre as principais, estão:

Mas quais destas marcas são realmente efetivas na proteção e combate a estas ameaças?

Aqui vamos ver resultados de testes de algumas soluções de mercado, realizados por uma organização que fornece um relatório semestral com os resultados, chamada AV-Comparatives.

Então, aqui não há informação baseada em opinião, e sim, apenas resultados.

Você poderá conferir estes dados em av-comparatives.org e baixar lá os relatórios completos.

Eu porém irei exibir apenas os dados mais importantes para este artigo.

São dois relatórios que foram analisados:

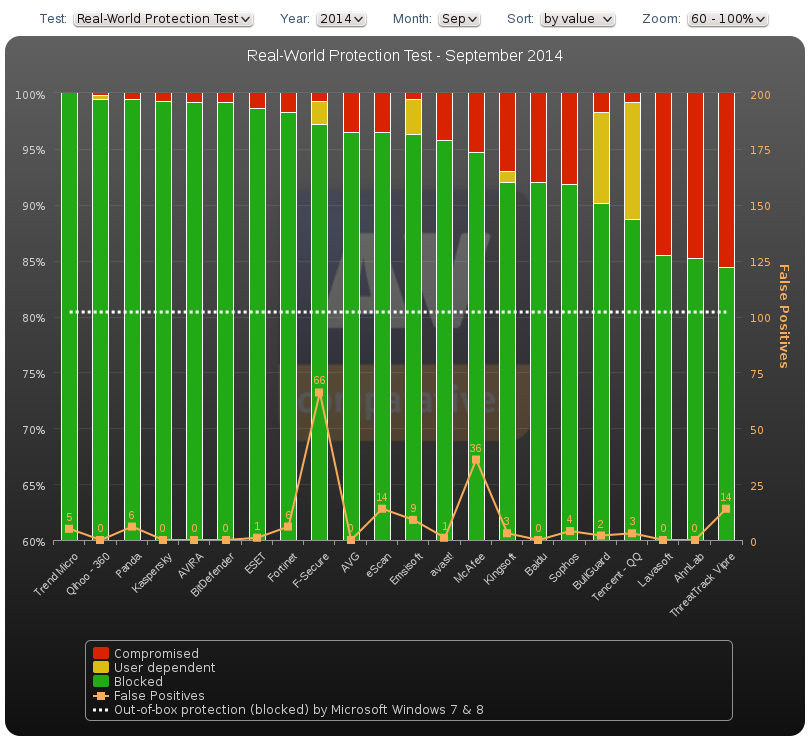

Um deles chama-se “Real World Protection Test“, que trata de analisar se o produto oferece proteção a ataques mais frequentemente encontrados. São usados 1.821 amostras de malwares neste teste.

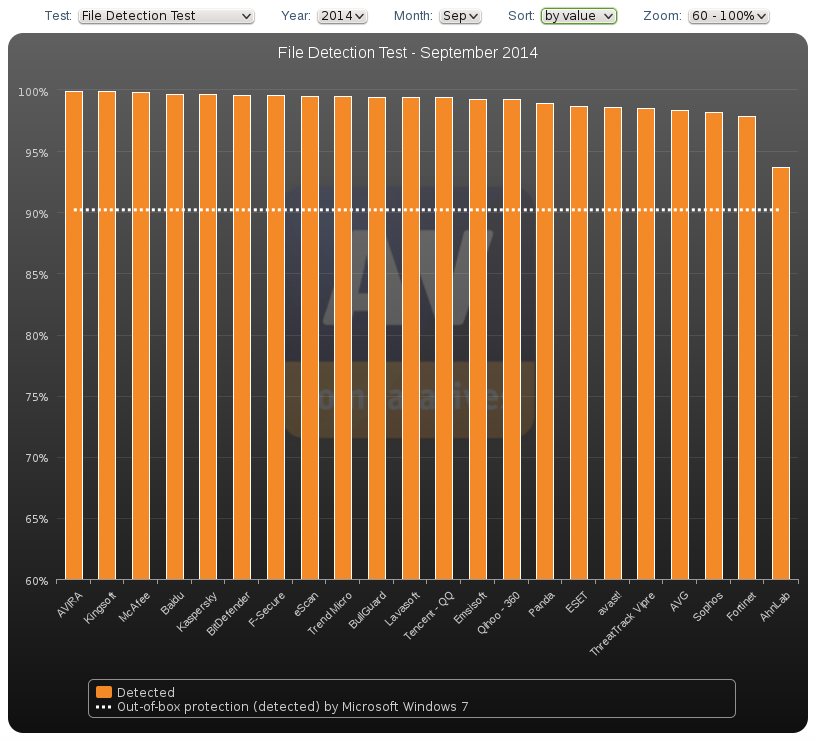

E o segundo chama-se “File Detected Test of Malicious Software“, que cuida de mostrar a taxa de detecção de malwares por produto, incluindo a taxa de falso positivos (que são quando o software de antivírus detecta uma ameaça que na verdade não é um malware). São usados 129.253 amostras de malwares neste teste.

As Marcas e Produtos testados por eles foram (em ordem alfabética):

O processo é usar um computador com uma imagem de instalação limpa, e realizar casos de testes para cada produto, colher os resultados, passar a imagem limpa e testar outro produto. Os testes levam cerca de 4 meses. Então o processo não é fácil e leva bastante tempo.

O processo é usar um computador com uma imagem de instalação limpa, e realizar casos de testes para cada produto, colher os resultados, passar a imagem limpa e testar outro produto. Os testes levam cerca de 4 meses. Então o processo não é fácil e leva bastante tempo.

Para visualizar um gráfico online dos resultados acesse: http://chart.av-comparatives.org/chart1.php

VAMOS AOS RESULTADOS:

1 – Do primeiro teste “Real World Protection Test”:

E creio que é o mais importante, pois ao contrário do teste de detecção por arquivo, este fornece o resultado de proteção geral da ferramenta, inclusive de resultados pró-ativos que impedem que sites, e arquivos cheguem até a máquina e contaminem o sistema operacional.

Esta é a taxa de proteção de ameaças (Maior é melhor).

Obs. Esta análise, conforme a tabela na primeira imagem acima, tem uma coluna chamada “User dependent” que significa que o programa de antivírus detectou o malware, mas pediu a interação do usuário para determinar uma ação sobre a detecção. Então é dado apenas meio crédito a detecção.

Então, as 5 melhores marcas são:

(em ordem da melhor para baixo)

* Trend Micro

* Qhoo – 360

* Panda

* Kaspersky

* Avira

Obs. Estes acima tiveram uma taxa de detecção superior a 99,5%

As 5 piores marcas são:

* ThreatTrack Vipre

* Ahnlab

* Lavasoft

* Tencent – QQ

* BullGuard

Obs. Os produtos das marcas Symantec e Microsoft foram tão mal, que nem entraram no ranking dos 22 melhores.

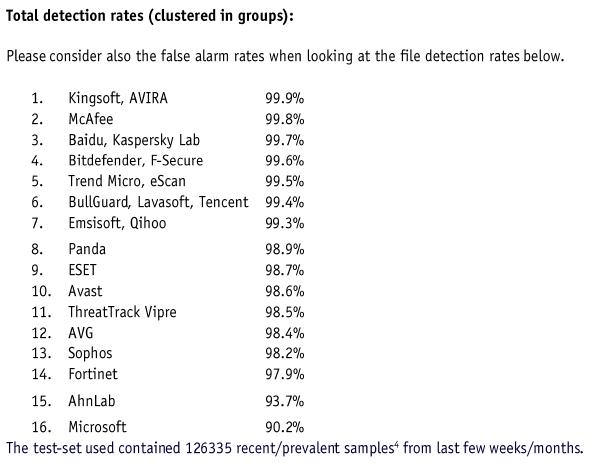

2 – Do segundo teste “File Detected Test of Malicious Software“:

(detecção de ameaças por arquivo)

Esta é a taxa de detecção de ameaças (Maior é melhor).

As marcas que possuem a mesma taxa foram agrupadas, lembrando que taxa de detecção por arquivo trata apenas deste tipo de proteção/detecção, não trata da proteção geral do produto e sua capacidade pró-ativa de impedir que os arquivos cheguem.

Então, as 5 melhores marcas são:

(em ordem da melhor para baixo)

* Avira e Kingsoft

* McAfee

* Kaspersky, Baidu

* BitDefender, F-Secure

* Trend Micro, eScan

Obs. Estes acima tiveram uma taxa de detecção superior a 99,5%

As 5 piores marcas são:

* Microsoft

* Ahnlab

* Fortinet

* Sophos

* AVG

Obs. Microsoft entrou nesse ranking, mas em últimos lugar 23o (não aparece no gráfico mais acima).

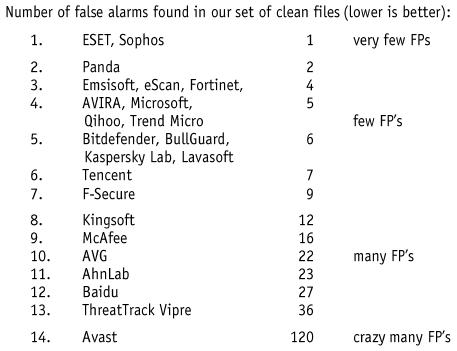

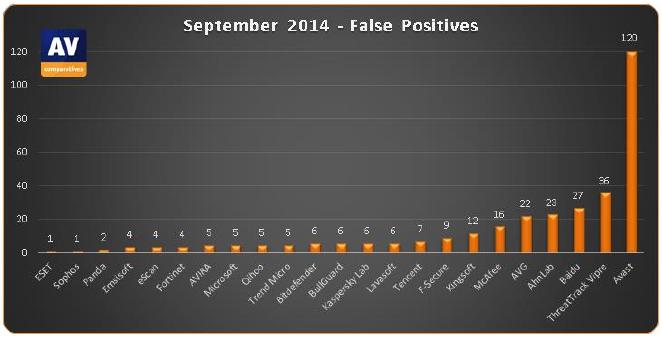

Falsos Positivos

São quando o programa de antivírus bloqueia uma aplicação legal, julgando erroneamente que ela é um malware.

Falsos Positivos: (menos é melhor)

Obs. Até chegar no Kingsoft que está na 17a posição, ainda tem um nível aceitável, mas daí em diante começa a ser uma falha muito grande do produto. Princialmente do produto Avast que loucamente bloqueou muitas aplicações legítimas erroneamente.

Um produto que tem bastante sucesso em detectar malwares, mas tem algum número de falsos positivos, não é necessariamente pior que um produto que detecta menos malwares e tem uma taxa muito baixa de falsos positivos.

Ou seja, pela lógica, um produto com baixo nível de detecção de malwares geralmente terá um baixo nível de detecção de falsas ameaças também, e baixa taxa de detecção de falsos positivos não evidencia que o produto seja bom, mas taxa exagerada de falsos positivos evidencia que o produto tem problemas, como foi o caso do Avast desta vez.

Lembrando que essas são as marcas mais premiadas, de acordo com o nível de qualidade:

É isso aí pessoal, agora, novos testes, apenas no ano que vem.

Abraços,

Cleuber

Cleuber.com.br Linux e Muito Mais

Cleuber.com.br Linux e Muito Mais